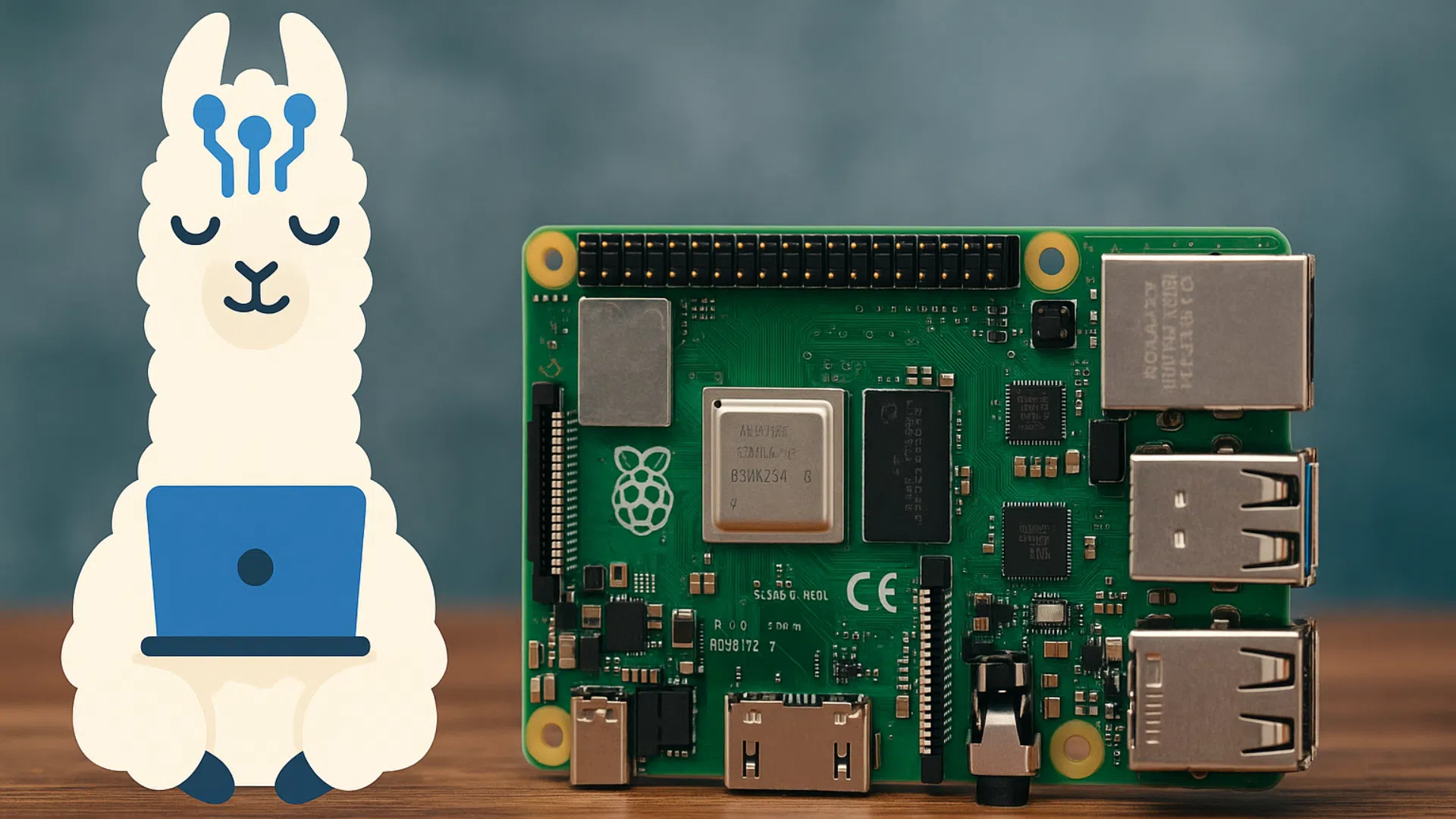

Ollama sur Raspberry Pi : l’intelligence artificielle en local chez vous

Introduction

L’intelligence artificielle n’est plus réservée aux géants du numérique. Aujourd’hui, il est possible d’exécuter des modèles de langage avancés directement en local, sans connexion à des serveurs distants.

C’est exactement ce que propose Ollama, une solution open source qui permet de faire tourner des modèles d’IA comme LLaMA 2, Mistral ou Vicuna sur un ordinateur personnel.

Et la bonne nouvelle ? Avec un peu de créativité, il est possible d’utiliser Ollama sur Raspberry Pi. Un moyen accessible de transformer ce petit ordinateur en mini-laboratoire d’IA personnelle.

Qu’est-ce que Ollama ?

Ollama est un moteur d’exécution pour modèles de langage (LLM) qui facilite le déploiement et l’utilisation de modèles IA localement.

Ses points forts :

- Exécution en local → pas besoin de cloud.

- Compatibilité avec plusieurs modèles : LLaMA 2, Mistral, Falcon, Gemma, Vicuna…

- Interface simple : ligne de commande claire et API REST pour les développeurs.

- Confidentialité : vos données ne quittent pas votre machine.

En résumé, Ollama démocratise l’accès à l’IA avancée en permettant à chacun de l’installer chez soi.

Pourquoi vouloir Ollama sur Raspberry Pi ?

1. Une IA locale à moindre coût

Un Raspberry Pi 5 coûte bien moins cher qu’un PC haut de gamme. Même si ses ressources sont limitées, il peut servir de serveur IA expérimental pour découvrir Ollama.

2. Confidentialité et contrôle

Avec Ollama, tout reste en local. Sur un Raspberry Pi, vous avez une solution d’IA autonome qui ne dépend d’aucun service externe.

3. Accessibilité

Un Pi est compact, silencieux et peu énergivore. Il peut tourner en permanence comme mini-serveur personnel.

4. Pour apprendre et expérimenter

Exécuter Ollama sur un Pi permet de mieux comprendre le fonctionnement des LLM, leurs limites et leurs usages, sans investir dans une machine coûteuse.

Les limites à garder en tête

Soyons réalistes : le Raspberry Pi, même en version 5, n’a pas la puissance brute d’un PC avec carte graphique dédiée.

Contraintes principales :

- RAM limitée : 4 à 8 Go (maximum 16 Go sur certaines éditions). Or les modèles LLM demandent souvent des dizaines de Go.

- Pas d’accélération GPU native : le Pi 5 repose surtout sur son CPU ARM, ce qui limite les performances.

- Temps de réponse plus long : faire tourner un gros modèle (même allégé) sur Pi entraîne une latence importante.

👉 En clair, le Raspberry Pi ne remplacera pas une station IA haut de gamme. Mais pour tester, héberger un modèle léger ou développer des projets pédagogiques, c’est parfait.

Quels usages d’Ollama sur Raspberry Pi ?

Chatbot personnel

Installer Ollama sur Pi permet de créer un assistant personnel accessible depuis un navigateur ou via API.

Serveur d’IA domestique

On peut imaginer connecter Ollama à un système domotique (Home Assistant, Node-RED) pour interagir en langage naturel avec sa maison connectée.

Laboratoire pédagogique

Un Raspberry Pi avec Ollama est un excellent outil pour apprendre l’IA : fine-tuning de petits modèles, test de prompts, intégration dans des apps.

Serveur local pour développeurs

Les programmeurs peuvent utiliser le Pi comme backend d’IA, par exemple pour générer du texte, résumer des notes ou tester des applications LLM.

Quels modèles utiliser sur Raspberry Pi ?

Étant donné les ressources limitées du Pi, il vaut mieux se tourner vers des modèles :

- Optimisés / quantisés (taille réduite, ex. Q4 ou Q5).

- Petits modèles (<3B paramètres) comme :

- LLaMA 2-7B quantisé (limite haute).

- Mistral 7B allégé.

- TinyLlama ou GPT4All-J (plus adaptés).

👉 Objectif : un compromis entre rapidité et qualité de réponses.

Raspberry Pi 5 : un bon candidat pour Ollama

Par rapport aux versions précédentes, le Pi 5 offre un vrai bond de puissance :

- CPU plus rapide (ARM Cortex-A76 2,4 GHz).

- Jusqu’à 8 Go de RAM (voire plus sur certaines déclinaisons).

- Support du SSD NVMe pour stocker de gros modèles.

Cela ouvre la porte à des expériences IA réalistes mais modestes.

Avantages et inconvénients

✅ Avantages

- Solution peu coûteuse pour tester Ollama.

- Compacte et silencieuse (idéal comme serveur d’appoint).

- Permet d’apprendre et d’expérimenter l’IA localement.

- Respect de la confidentialité des données.

❌ Inconvénients

- Puissance limitée (latence importante).

- Ne supporte pas les très gros modèles (>7B).

- Pas adapté pour un usage professionnel intensif.

Conclusion

L’installation d’Ollama sur Raspberry Pi n’a rien d’un choix de performance brute. Ce n’est pas une solution pour remplacer un PC avec GPU, mais plutôt une porte d’entrée accessible vers l’IA locale.

Avec un Raspberry Pi 5 et des modèles allégés, il devient possible de créer son mini-serveur d’intelligence artificielle personnel : un chatbot local, un assistant domotique, ou un laboratoire d’apprentissage.

👉 Si vous êtes curieux, maker ou développeur, Ollama sur Raspberry Pi est un excellent moyen d’explorer l’IA autrement : plus locale, plus privée et plus accessible.